每日經濟新聞 2025-06-09 19:01:49

近日,蘋果機器學習研究中心發表論文指出,現有的推理模型看似會“思考”,但其實并沒有穩定、可理解的思維過程,所謂的推理思考只是一種“幻象”。這一觀點引發AI圈熱議,有研究人員認為蘋果的測試方法存在問題,輸出token限制可能是推理模型表現不佳的原因。也有部分觀點指責蘋果因其AI進展不順,“吃不到葡萄說葡萄酸”。

每經記者|宋欣悅 每經編輯|高涵

當地時間6月6日,蘋果機器學習研究中心發表論文《思考的幻象:通過問題復雜性的視角理解推理模型的優勢與局限》。論文作者包括谷歌大腦聯合創始人Samy Bengio(圖靈獎得主Yoshua Bengio的弟弟)。

該論文認為,現有的推理模型看似會“思考”,但其實并沒有穩定、可理解的思維過程,所謂的推理思考只是一種“幻象”。

論文發布后引發AI圈熱議,被部分觀點解讀為“蘋果否定所有大模型的推理能力”。也有研究人員提出反駁,認為蘋果的測試方法存在問題。AI研究者Lisan al Gaib在復現論文中的漢諾塔測試后發現,模型根本不是因為推理能力不佳而失敗,而是因為輸出token限制。

圖片來源:論文《思考的幻象:通過問題復雜性的視角理解推理模型的優勢與局限》

論文指出,OpenAI、Anthropic、谷歌和DeepSeek等公司紛紛推出帶有“鏈式思考”(Chain-of-Thought,CoT)能力的模型,并聲稱它們更接近“類人思維”。

然而,該論文認為,現有的推理模型看似會“思考”,但其實并沒有穩定、可理解的思維過程,所謂的推理思考只是一種“幻象”。

蘋果團隊認為,在實驗設計上,現有評估主要集中在既定的數學和編碼基準上,通過判斷模型最終答案是否正確來評估其能力,這種方式可能存在數據污染,即模型在訓練時可能見過類似題目。此外,這些評估大都缺乏對“思考過程質量”的分析。

為此,蘋果團隊設計了四類謎題環境,包括漢諾塔、跳棋交換、過河問題和積木世界,通過精確控制謎題難度,來測試推理模型的推理能力。

圖片來源:《思考的幻象:通過問題復雜性的視角理解推理模型的優勢與局限》

推理模型并未解決模型能力瓶頸

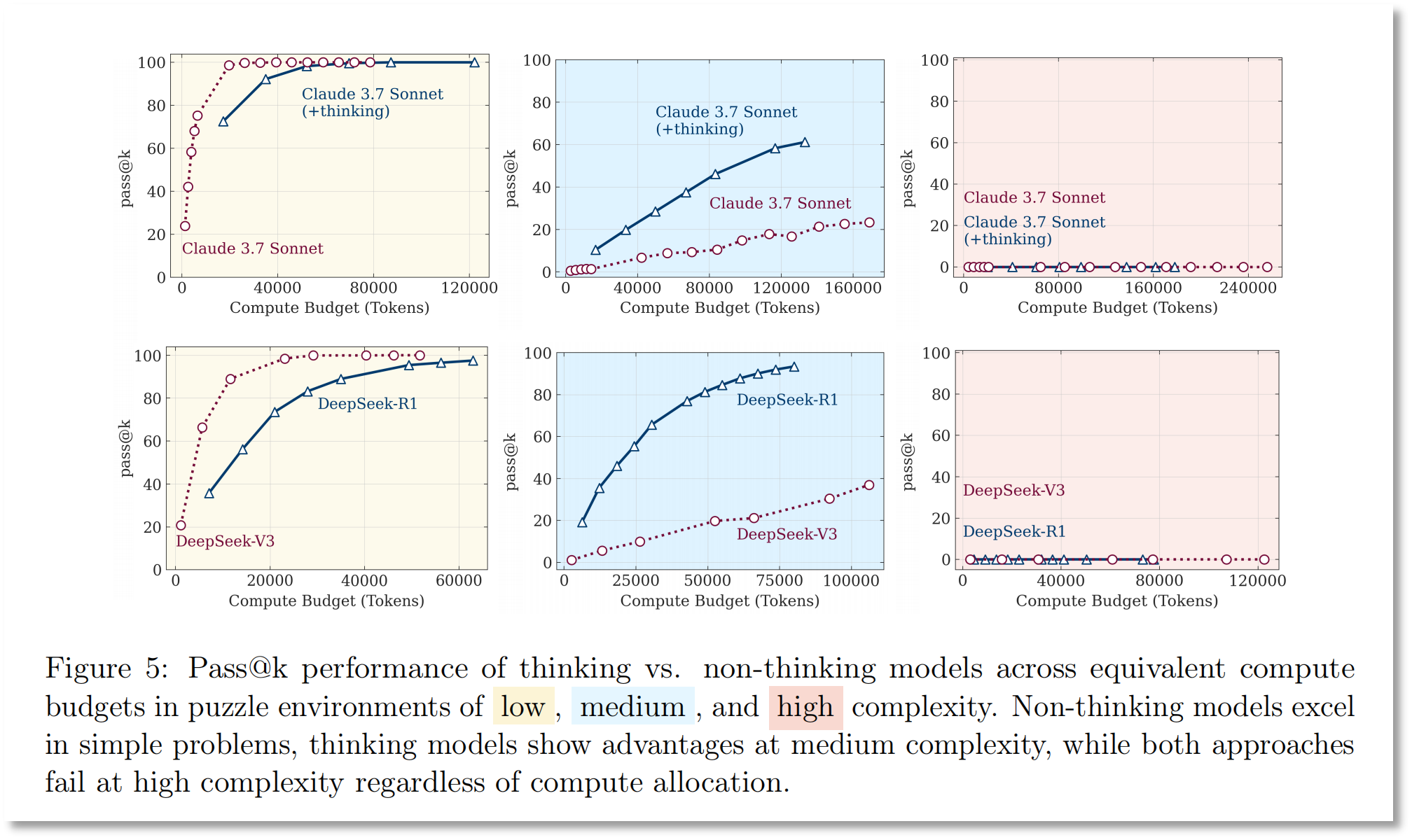

實驗結果顯示,面對低復雜度任務,非推理模型比與之對應的推理模型更準確高效。當問題復雜度適度增加,推理模型優勢顯現,性能超過非推理模型。

但當問題難度超過一定臨界點時,兩類模型性能均嚴重下降,準確率為零。這表明,推理模型并沒有實際性地解決模型的能力瓶頸。

圖片來源:《思考的幻象:通過問題復雜性的視角理解推理模型的優勢與局限》

面對難題,直接“躺平”

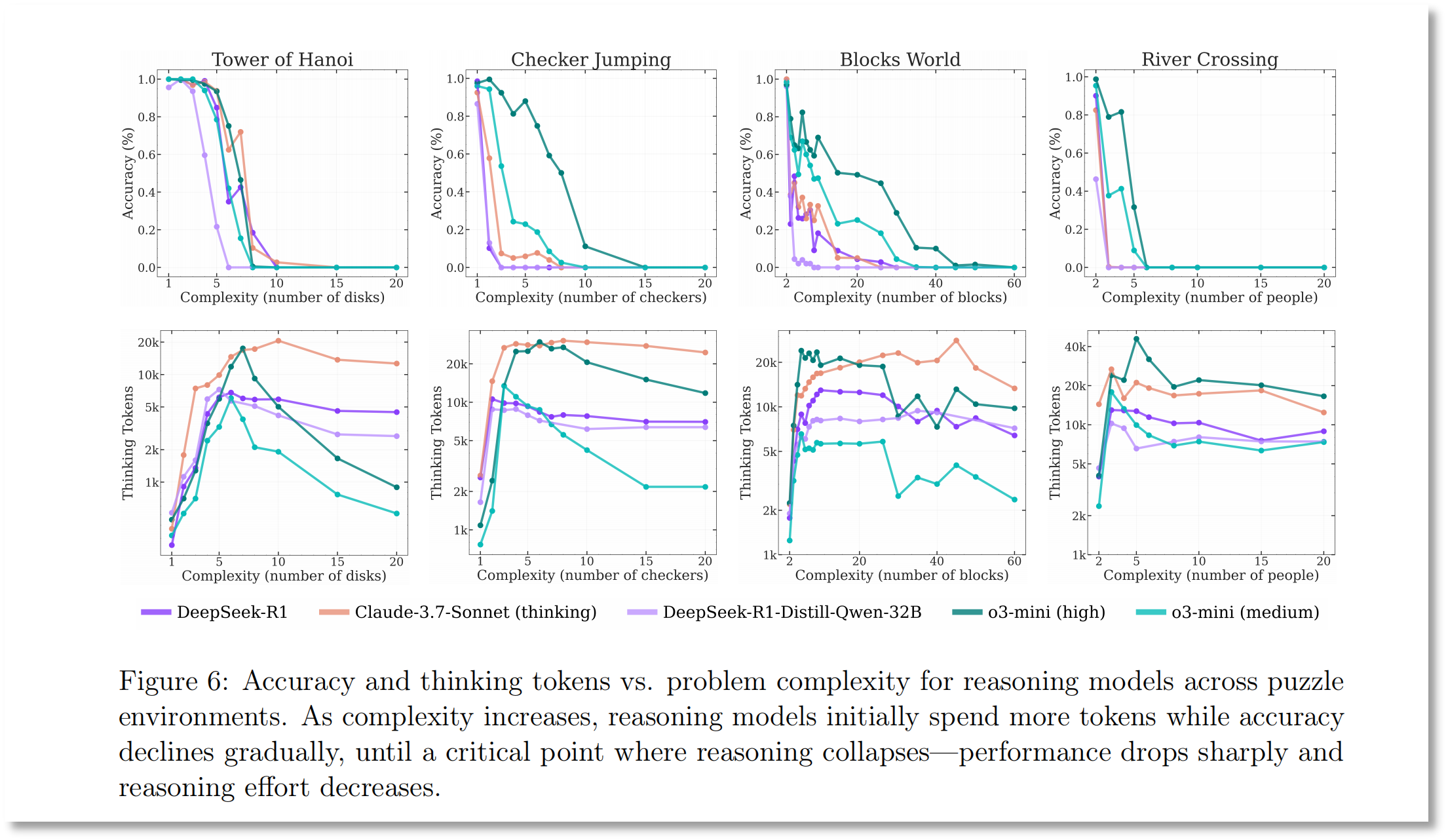

同時,研究還發現,隨著問題復雜度的增加,推理模型在初期會投入更多的思考token。然而,當問題難度達到某個臨界點時,模型推理能力就會發生崩潰,思考不增反降。

這表明,推理模型似乎存在一個內在的“縮放限制”。當它預感到問題過于困難無法解決時,即便有充足的計算預算(token limit),它也會選擇“躺平”,減少思考的努力。

過度思考,連“抄作業”都不會

此外,研究人員不僅關注最終答案,還分析了推理痕跡——即給出答案之前生成的逐步“思考”過程。他們發現,在簡單的問題中,模型往往在早期就找到了正確的解決方案,但隨后繼續進行不必要的思考。

在中等復雜度的問題中,模型往往在推理過程中走錯路徑,最終在“思考”的后期才找到正確的答案。但在高復雜度的問題中,準確度為零,推理變得混亂或不連貫。

更令人擔憂的是,在漢諾塔任務中,研究人員直接在提示詞中提供了完整的解題算法,要求模型僅僅是“執行”這個算法。但模型的表現沒有任何改善,依然在相同的復雜度上崩潰。

蘋果此次發布的論文在AI圈引發了不小的爭議。

AI研究者Lisan al Gaib在復現論文中的漢諾塔測試后發現,模型根本不是因為推理能力不佳而失敗,而是因為輸出token限制。

也就是說,不是模型不會解答,而是無法輸出如此多的內容。

GitHub軟件工程師Sean Goedecke稱,存在復雜性閾值并不意味著推理模型“實際上并不推理”。

Sean表示,即使沒有推理到第十一步,但前十步仍是在推理。“根據我自己測試的結果,模型很早就決定數百個算法步驟太多了,根本無法嘗試,因此它們干脆不開始。”

Sean舉了一個例子,“有多少人能坐下來正確地算出一千步漢諾塔?有很多人能做到,但也有很多做不到。那么,那些算不出答案的人就沒有推理能力嗎?當然有!他們只是沒有足夠的認真和耐心去手動完成一千次算法的迭代。”

著名AI越獄提示詞專家Plenny the Liberator直言,如果我是蘋果CEO,看到我的團隊發表一篇只專注于記錄當前方法局限性的論文,我會當場解雇所有參與者。

AI博主henry表示,“蘋果作為世界上最富有的公司,擁有無與倫比的優勢,全力押注人工智能,許下無數承諾,但被所有人瞬間超越。賽程已進行兩年,卻一無所獲,于是寫了這篇論文說這一切都是不重要的。”

部分觀點認為,蘋果發布質疑推理模型能力的論文是“吃不到葡萄說葡萄酸”。

北京時間6月10日凌晨1點,蘋果年度開發者大會(WWDC 2025)即將拉開帷幕。然而,外界普遍認為,這次活動在AI方面的進展可能有限,備受期待的Siri升級也將繼續缺席。

據外媒報道,此次WWDC上蘋果在AI方面的更新不會帶來太多驚喜。科技記者馬克·古爾曼發文透露,蘋果今年WWDC中關于AI的內容預計會比較少,甚至可能“令人失望”。

在去年WWDC上發布蘋果智能(Apple Intelligence)時,蘋果曾高調宣布對語音助手Siri進行“徹底重構”,新Siri應該更聰明、更懂用戶、能夠理解并執行復雜任務。然而,一年過去,Siri的升級卻遲遲未見實質性進展。

據多位前蘋果員工透露,蘋果AI領域的進展不順,部分原因在于公司內部領導風格的差異和組織間的協作問題。

另一方面,蘋果在AI領域的探索,也受到了技術路線選擇和隱私政策帶來的雙重影響。蘋果一直以來引以為傲的“隱私至上”原則,在AI時代給其帶來了一些新的負擔。一位熟悉蘋果AI和軟件開發工作的人表示:“在蘋果公司開發AI的過程中,做任何事情都可能遇到很多‘不’,你必須與負責隱私的部門反復溝通協調才能推進工作。”

如需轉載請與《每日經濟新聞》報社聯系。

未經《每日經濟新聞》報社授權,嚴禁轉載或鏡像,違者必究。

讀者熱線:4008890008

特別提醒:如果我們使用了您的圖片,請作者與本站聯系索取稿酬。如您不希望作品出現在本站,可聯系我們要求撤下您的作品。

歡迎關注每日經濟新聞APP